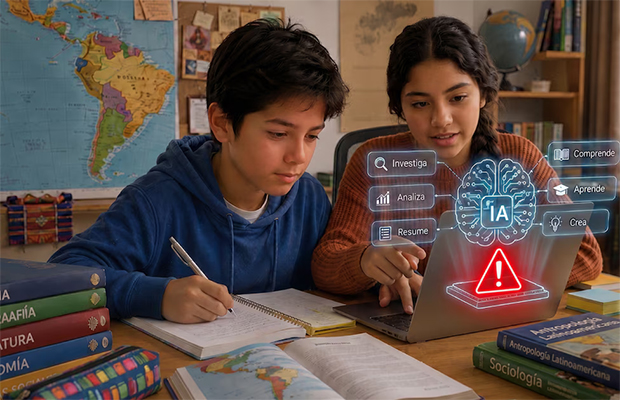

“¿Cómo utilizo la IA? Para mí no es más que una simple herramienta. La utilizo para que sea mi guía, mi orientadora y también para buscar información de una manera muy rápida y efectiva, de un tema específico, y luego yo lo analizo y lo desarrollo. No dejo que sea la que resuelva mis problemas”, cuenta Oscar, un estudiante venezolano, de 17 años. La inteligencia artificial ya forma parte de las aulas, y su rol, alcance e impacto en niños y adolescentes preocupa a padres, docentes y especialistas en la salud mental de todo el mundo.

“La IA no es el futuro. Es el presente”, enfatiza María José Ravalli, Jefa Regional de Abogacía y Comunicación de UNICEF, quien aporta datos concretos sobre su uso extendido: “En América Latina, la inteligencia artificial ya forma parte del día a día de millones de niños, niñas y adolescentes. En Argentina, un tercio de los chicos usa inteligencia artificial con fines escolares”. La especialista destaca que hoy la IA forma parte de los procesos de enseñanza, absorción de información y vinculación con pares.

“Cuando tengo un tema difícil, le pido que me haga un resumen o que me lo explique de una manera más simple para lograr comprenderlo mejor. También lo utilizo para organizar ideas”, detalla Fiorela, una estudiante costarricense de 17 años. La inteligencia artificial puso al alcance de la mano información como nunca antes. La posibilidad de repreguntar cuantas veces sea necesario, recibir explicaciones personalizadas o resolver dudas sin la exposición que impone el aula aparece como uno de los principales atractivos de estas herramientas para los estudiantes.

UNICEF reconoce las bondades de esta tecnología en la educación, especialmente su capacidad de ofrecer nuevas herramientas de aprendizaje, ampliar el acceso a la información y favorecer la inclusión de personas con discapacidad.

Como parte del proyecto Children’s Best Interests in a Digital World (El interés superior de la infancia en un mundo digital), UNICEF Innocenti consultó en siete países a niñas y niños de entre 10 y 17 años sobre sus derechos en el mundo digital, y frecuentemente surgió el tema de la IA. Contaban que ya usan herramientas como ChatGPT para hacer resúmenes de sus tareas escolares, explicar conceptos complejos de manera más sencilla o incluso como guía sobre qué publicar o no en redes sociales.

La IA está en todas partes. No solo aparece en herramientas como ChatGPT. También está integrada en redes sociales, como Instagram o TikTok y plataformas digitales que los chicos usan a diario. Los algoritmos que funcionan con esta tecnología recomiendan qué videos ver, qué noticias leer y con quién conectar; y cada vez más, los sistemas de IA generativa (Claude, ChatGPT, Grok) están creando el propio contenido que consumen los niños y niñas, llegando incluso a posicionarse como “amigos”.

Ravalli entiende que la IA genera oportunidades, mejora el acceso a la información, favorece la inclusión educativa y permite el aprendizaje personalizado, pero al mismo tiempo, dice que entraña “nuevos riesgos, como la desinformación, los sesgos en los resultados y la dependencia emocional de chatbots”. A esos se suman otros riesgos de mayor gravedad y complejidad.

“Según un estudio de UNICEF realizado el año pasado en once países, al menos uno punto dos millones de niños y niñas fueron afectados por la manipulación de imágenes personales con contenido sexual. Y aunque la imagen sea falsa, el daño es absolutamente real”. Mientras niños y adolescentes lideran la adopción de herramientas de IA, todavía existe poca evidencia sobre sus efectos cognitivos, emocionales y sociales a mediano y largo plazo.

En Argentina, más de la mitad de las niñas y niños de 9 a 17 años usa inteligencia artificial (IA) y, de ellos, dos de cada tres lo hacen con fines escolares, según el estudio Kids Online Argentina, de UNICEF y UNESCO. En Brasil, esta cifra supera ya el 65%.

“Frente a este escenario, la clave es acompañar a los niños, entender cómo funciona la inteligencia artificial, hablar abiertamente sobre su uso, acompañar sus consumos digitales y fomentar el pensamiento crítico. La alfabetización digital es tan importante como enseñar cualquier otra habilidad, pero la responsabilidad no puede caer solo en las familias -destaca Ravalli-. Es clave que las empresas tecnológicas diseñen productos seguros desde el inicio y también que los gobiernos establezcan reglas, legislaciones que sean claras y que protejan a la infancia”.

Si bien el uso de la IA puede ayudar a desarrollar nuevas habilidades y prepararse mejor para un entorno laboral que cambia a toda velocidad, lo cierto es que están surgiendo riesgos en los que las familias se encuentran desorientadas, incapaces de responder sobre sus efectos, que aun no se conocen lo suficiente.

Entre ellos, la desinformación, ya que la IA no está exenta de reproducir o amplificar información falsa que circula en Internet. Sin acompañamiento, niñas, niños y adolescentes pueden acceder a perfiles, contenidos o datos que no son confiables.

Los sesgos, dado que los sistemas de IA pueden ofrecer resultados basados en prejuicios o errores presentes en los datos con los que fueron diseñados o entrenados. Esto puede derivar en información incompleta, estereotipos o recomendaciones poco diversas.

Otro de los riesgos es la dependencia emocional de chatbots o “acompañantes” de IA. Si una herramienta de IA está mal diseñada o no cuenta con regulaciones adecuadas, puede exponer datos personales, afectar la intimidad o generar pérdida de control sobre la información compartida. Además, los chatbots que responden o se comportan como personas, suelen dar consejos a los usuarios sobre su vida personal e íntima.

En este tipo de interacciones, los menores son más susceptibles a la manipulación y explotación. Son más proclives a desarrollar una relación de dependencia con estos acompañantes, y compartir información privada. Por eso UNICEF recomienda que los chatbots se diseñen, regulen y comercialicen teniendo en cuenta los intereses y seguridad de la infancia.

El Deepfake y su daño real

Cada vez son más los niños y adolescentes que se enfrentan al Deepfake. Están cada vez más expuestos a ser víctimas, como dice María José Ravalli, de imágenes falsas que provocan un daño real. El Deepfake consiste en imágenes, vídeos o grabaciones de voz generados o manipulados por inteligencia artificial (IA) con apariencia de realidad, que se están utilizando cada vez más para crear contenido sexualizado de niños y niñas, incluida la “nudificación”, que se refiere al uso de las herramientas de IA para retirar o modificar la ropa en fotografías con el fin de crear imágenes sexualizadas o desnudos falsos.

Un estudio de UNICEF, ECPAT e INTERPOL dio cuenta de que en once países, al menos 1,2 millones de niños y niñas dijeron haberse visto afectados en el último año por la manipulación de sus imágenes mediante deepfakes con contenido sexual explícito. En algunos países, esa cifra representa uno de cada 25 niños y niñas, lo que equivaldría a un niño o una niña de un aula escolar estándar.

UNICEF acaba de publicar una Guía para acompañar la vida digital de los niños y adolescentes, donde comparte algunos recursos, recomendaciones e información sobre la IA para que madres, padres y educadores puedan fortalecer las habilidades digitales de la infancia, y proteger sus derechos.

Para responder a estos desafíos, una de las primeras medidas sería informarse, tanto sobre los aspectos positivos y negativos de esta nueva tecnología, así como sobre la utilidad que le dan los chicos. En un primer acercamiento, la propuesta es preguntar y observar para que la usan.

Una vez informados, están en situación de poder conversar con ellos sobre la IA, sus oportunidades y riesgos. El diálogo es fundamental para que los menores entiendan que el uso de estas herramientas implica derechos, pero también responsabilidades. Usar disparadores reales, como una tarea en particular, permite dialogar sobre cuándo, para qué y cómo usarla. Asimismo, UNICEF promueve el pensamiento crítico. Ying Xu, profesora asistente de IA en aprendizaje y educación en la Universidad de Harvard, advierte que es importante explicarles que muchos sistemas de IA, por diseño, son siempre complacientes y alentadores, algo que no refleja la realidad de las relaciones personales, que a menudo implican desacuerdos, compromisos y la capacidad de gestionar conflictos.

Si los niños y niñas pasan mucho tiempo con sistemas así, pueden desarrollar ideas poco realistas sobre cómo funcionan las amistades y las relaciones. “Hay preocupaciones a más largo plazo que conviene tener en cuenta. Una de ellas es que los niños y niñas pueden empezar a depender de la IA en lugar de recurrir a otras personas. En nuestra investigación con adolescentes, algunos compartieron que hablar con la IA resulta más fácil que hacerlo con sus compañeros o con adultos”, explica Xu.

Entender cómo funcionan estas herramientas, qué datos recopilan y con qué fines se utilizan ayuda a que niñas, niños y adolescentes desarrollen una mirada más consciente sobre la tecnología.

Por último, la guía invita a promover conversaciones responsables con pares. Leer sobre el tema, escuchar podcasts o ver videos de fuentes confiables permite entender mejor el funcionamiento de la IA, “que no piensa ni siente”. Cuanto mayor es la información, menores son los riesgos asociados a su uso. Por eso, conversar con sus amigas y amigos puede ayudar a las niñas y niños a reflexionar. Algunas preguntas que pueden hacer a sus pares incluyen: ¿Cómo influye la IA en mi vida diaria? ¿Cuánto la uso y para qué?

“Me gustaría que la inteligencia artificial mejore en cómo maneja la información falsa o dañina. Esto es muy importante, ya que muchos niños, niñas y adolescentes utilizan estas herramientas para aprender o buscar información. Entonces, es clave que lo que encuentren sea seguro y confiable, y también que tengan las herramientas necesarias para aprender a utilizar la IA de manera responsable”, plantea la estudiante costarricense. “Para mí es una herramienta que puede utilizarse para aprender si se usa bien”, afirma, consciente de que el uso de estas herramientas también implica riesgos.

Con información de Infobae